Zaczyna się niewinnie. Netflix sugeruje ci film, który „mogą ci się spodobać”. Amazon podsuwa książkę, którą „klienci o podobnych zainteresowaniach” właśnie kupili. Facebook pokazuje posty od przyjaciół, z którymi najczęściej wchodzisz w interakcje. To wygodne. Przyjemne. Jak rozmowa ze starym przyjacielem, który zna twój gust, poczucie humoru i poglądy. Z czasem jednak ta wygoda zaczyna nabierać innego wymiaru. Zauważasz, że twoja linia informacyjna staje się coraz bardziej spójna, przewidywalna, jednolita. Niepokojące wiadomości z drugiej strony barykady politycznej znikają. Poglądy, które mogłyby cię zdenerwować, są dyskretnie filtrowane. Zostajesz otulony aksamitną, cyfrową kołdrą treści, które potwierdzają to, co już wiesz, i to, co już lubisz. Witamy w erze algorytmicznej personalizacji – świata, w którym niewidzialny mechanizm nie tylko odzwierciedla twoje preferencje, ale aktywnie je kształtuje, tworząc dla ciebie wersję rzeczywistości tak dopasowaną, że zaczyna ona wypierać tę obiektywną. To nie jest już tylko kwestia wygody. To fundamentalna zmiana w tym, jak postrzegamy świat, jak podejmujemy decyzje i, co najgłębiej niepokojące, jak postrzegamy samych siebie.

Aby zrozumieć potęgę tego zjawiska, musimy zajrzeć za kulisy działania tych algorytmów. Ich celem nie jest poszerzanie naszych horyzontów, edukacja czy wspieranie krytycznego myślenia. Ich jedynym, mierzalnym celem jest maksymalizacja zaangażowania użytkownika. Czas spędzony na platformie, liczba kliknięć, lajków, udostępnień, komentarzy – to waluta, w której rozliczana jest skuteczność algorytmu. A co najlepiej angażuje ludzki mózg? Nie są to złożone, wieloaspektowe analizy. Są to silne emocje: gniew, oburzenie, strach, poczucie moralnej wyższości, a także przyjemne poczucie bycia zrozumianym i potwierdzonym. Algorytm staje się więc mistrzem w dostarczaniu nam tego, co wywołuje w nas najsilniejszą reakcję. Uczy się nas lepiej niż my sami, ponieważ śledzi nie to, co deklarujemy, że lubimy, ale to, na co faktycznie, instynktownie reagujemy. Klikniesz w sensacyjny nagłówek o skandalu politycznym, choć deklarujesz, że nie interesujesz się polityką? Algorytm zanotuje: „reaguje na polityczne sensacje”. Spędzasz dwadzieścia minut, przewijając filmiki z uroczymi kotami? Algorytm zanotuje: „potrzebuje rozrywki opartej na pozytywnych emocjach”. Z każdym takim kliknięciem, pauzą, lajkiem, buduje się twój „cyfrowy sobowtór” – profil psychologiczny tak szczegółowy, że może przewidzieć twoje reakcje z większą dokładnością niż niektórzy twoi przyjaciele.

Psychologicznie, proces ten wykorzystuje kilka kluczowych mechanizmów. Pierwszym i najpotężniejszym jest efekt potwierdzenia. To nasza naturalna tendencja do poszukiwania, faworyzowania i zapamiętywania informacji, które potwierdzają nasze istniejące przekonania. Algorytm jest idealną maszyną do potwierdzania. Jeśli jesteś konserwatystą, twój feed będzie pełen artykułów krytykujących lewicę. Jeśli jesteś weganinem, zobaczysz głównie posty o okrucieństwie przemysłu mięsnego i zaletach diety roślinnej. To sprawia, że czujemy się komfortowo i… mądrzy. Nasze poglądy wydają się oczywiste, ponieważ cały otaczający nas cyfrowy świat je potwierdza. Problem w tym, że prawda rzadko bywa jednolita. Złożone problemy wymagają zobaczenia wielu perspektyw. Algorytm, karmiąc nas tylko tym, z czym się zgadzamy, pozbawia nas tej możliwości. Zamyka nas w „bańce filtrującej” – komfortowym, ale iluzorycznym świecie, w którym wszyscy myślą tak jak my, a ci, którzy myślą inaczej, są albo głupi, albo źli.

Kolejnym mechanizmem jest efekt czystej ekspozycji. Im częściej jesteśmy wystawieni na jakąś ideę, produkt czy osobę, tym bardziej wydaje nam się ona znajoma, a przez to – bezpieczna i pozytywna. Algorytm, nieustannie podsuwając nam te same typy treści, sprawia, że pewne idee stają się dla nas „normalne”, podczas inne, które nie przechodzą przez filtr, wydają się obce i podejrzane. To algorytm decyduje, które trendy, które gwiazdy, które style życia będą nam prezentowane, a które pozostaną w cieniu. W ten sposób nie tylko odzwierciedla nasze preferencje, ale aktywnie je kreuje, powoli i niepostrzeżenie zmieniając nasze poczucie estetyki, normy społeczne i polityczne sympatie.

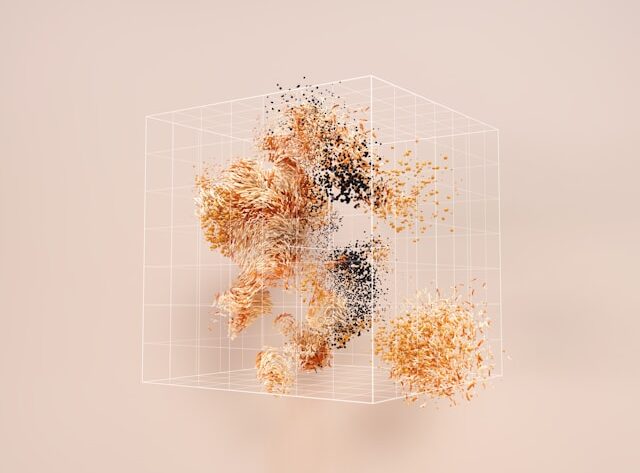

Najgłębsze niebezpieczeństwo personalizacji leży jednak w jej wpływie na naszą tożsamość. Kim jesteśmy? W dużej mierze jesteśmy opowieścią, którą sami sobie tworzymy na podstawie naszych wspomnień, przekonań i wartości. Algorytm staje się współautorem tej opowieści. Dostarcza nam ciągłego strumienia „dowodów” na słuszność naszych poglądów. Jeśli w głębi duszy czujesz się niepewnie w jakiejś kwestii, a algorytm nieustannie zasila cię treściami, które potwierdzają jedną stronę, twoja niepewność maleje. Zaczynasz utożsamiać się z tą jedną, algorytmicznie wzmocnioną wersją siebie. Twoja tożsamość staje się sztywniejsza, mniej elastyczna, bardziej polaryzowana. Złożona, wewnętrznie sprzeczna istota ludzka zostaje sprowadzona do zestawu danych, które można łatwo skategoryzować i wykorzystać. Algorytm nie rozumie niuansów, wątpliwości, dnia, kiedy masz ochotę posłuchać muzyki country, choć na co dzień preferujesz jazz. Wygładza te chwile, tworząc dla ciebie spójną, ale uproszczoną wersję ciebie samego – i to do tej wersji cię następnie przekonuje.

W sferze społecznej skutki są jeszcze poważniejsze. Gdy każdy z nas żyje w swojej personalizowanej rzeczywistości, wspólna przestrzeń dyskusji zanika. Jak rozmawiać z kimś, kto został przekonany przez swój algorytm, że twoje poglądy są nie tylko błędne, ale i niemoralne? Jak budować kompromis, gdy druga strona jest karmiona wyłącznie informacjami, które przedstawiają cię jako wroga? Personalizacja treści jest jednym z głównych silników polaryzacji społecznej. Nie tylko pokazuje nam innych w krzywym zwierciadle, ale także utwierdza nas w przekonaniu, że nasza perspektywa jest jedyną słuszną, bo cały nasz cyfrowy świat na to wskazuje.

Czy jesteśmy wobec tego bezbronni? Nie do końca. Świadomość działania tych mechanizmów jest pierwszym i najpotężniejszym krokiem do odzyskania kontroli. Możemy świadomie poszukiwać perspektyw, które różnią się od naszych. Możemy czytać media o różnych profilach światopoglądowych, śledzić ludzi, z którymi się nie zgadzamy (byle prowadzili merytoryczną dyskusję). Możemy regularnie czyścić naszą historię przeglądania i wyłączać personalizację tam, gdzie to możliwe. To jak otwieranie okna w dusznej, perfumowanej komnacie – wpuszcza trochę świeżego, czasem chłodnego, ale orzeźwiającego powietrza.

Algorytm, który zna cię lepiej niż ty sam, jest zarówno produktem, jak i twórcą naszej epoki. Odbija nasze najgłębsze pragnienie bycia zrozumianym i potwierdzonym, ale zaspokajając je w tak ekstremalny sposób, zagraża naszej zdolności do rozwoju, zmiany zdania i prawdziwego spotkania z Innym. Prawdziwe wyzwanie nie polega na tym, by całkowicie odrzucić technologię, ale na tym, by zachować przestrzeń dla siebie samego – dla tej części nas, która jest nieprzewidywalna, pełna sprzeczności, otwarta na zaskoczenie i zdolna do kwestionowania nie tylko świata, ale i samej siebie. W świecie, który chce nas zaszufladkować, największym aktem buntu jest pozostanie tajemnicą, także dla samego siebie. Bycie kimś, kogo nawet najpotężniejszy algorytm nie jest w stanie w pełni zdefiniować, ponieważ wciąż ewoluujemy, wciąż zadajemy pytania i wciąż mamy odwagę spojrzeć poza granice własnej, wygodnej, algorytmicznej bańki.